¿La IA reemplazará al patólogo en la era de la Patología Digital?

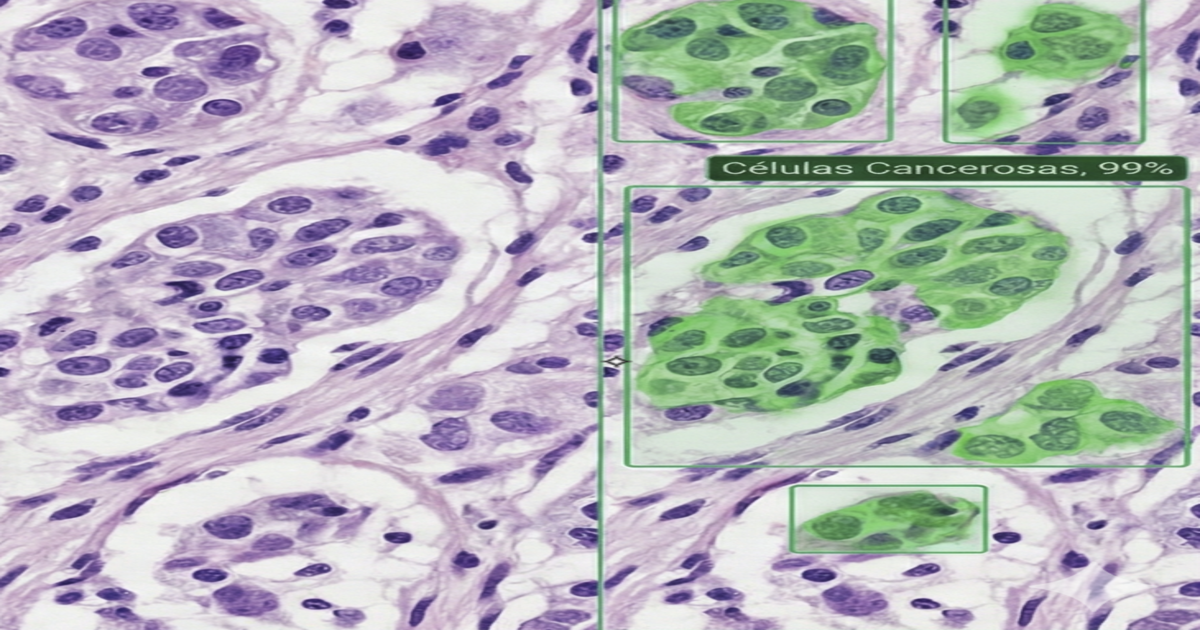

La IA ya analiza biopsias en WSI (Whole Slide Imaging) con alto rendimiento en tareas concretas: triage, cuantificación, detección de patrones y apoyo a biomarcadores. La pregunta correcta no es “¿desaparece el patólogo?”, sino: ¿cómo se diseña un sistema patólogo + IA que sea seguro, reproducible, interoperable y auditable?

1) Juicio clínico (sin sensacionalismo): ¿será “realidad” o no?

La IA no está “por llegar” a la morfopatología: ya es operativa en tareas específicas de alto volumen y alta variabilidad humana (triage, cuantificación, detección de patrones, apoyo a biomarcadores). Lo que no es realista (ni deseable) en el corto/medio plazo es un escenario donde un algoritmo asuma en solitario la responsabilidad diagnóstica clínica.

El futuro más probable es un sistema híbrido: la IA actúa como copiloto cuantitativo y el patólogo conserva el rol de integrador clínico-morfológico y responsable final del informe.

2) ¿Cómo “diagnostica” una IA una biopsia?

En patología digital se trabaja con WSI (Whole Slide Imaging): imágenes gigapíxel de una lámina histológica escaneada. Para analizarlas, el flujo técnico típico combina preprocesamiento, modelos de visión por computador y agregación a nivel de lámina/caso.

- Escaneo WSI (H&E, IHQ, tinciones especiales) → archivo digital.

- Preprocesamiento: control de calidad (desenfoque/artefactos), normalización de color y “tiling” (parches).

- Inferencia con redes neuronales (CNN/Transformers): clasificación, segmentación, detección.

- Agregación por caso (slide-level/case-level). En muchos escenarios se usan enfoques tipo MIL.

- Salida explicable: mapas de calor (heatmaps) + métricas (porcentajes, densidades, scores).

- Validación y monitorización: rendimiento local, drift y recalibración.

| La IA suele hacer bien | Lo que no “resuelve” por sí sola | Por qué importa |

|---|---|---|

| Triage, recuentos, cuantificación (Ki-67/PD-L1 según herramienta), detección de focos pequeños | Asumir responsabilidad clínica autónoma, integrar historia/iatrogenia, manejar incertidumbre compleja | Define protocolos de uso: apoyo, no sustitución |

| Consistencia en tareas repetitivas | Generalizar a todo laboratorio sin validación | Batch effects y drift pueden degradar rendimiento |

| Heatmaps y señales para revisión dirigida | Explicación causal completa | La “explicabilidad” clínica requiere umbrales y controles |

3) Casos de uso (reales) con valor clínico

3.1 Oncología: detección/clasificación en WSI

En cáncer, el rendimiento se reporta con métricas como AUC (AUROC), sensibilidad y especificidad. En la práctica, el valor está en: triage (acelerar tiempos), screening de micrometástasis y cuantificación reproducible de biomarcadores (según herramienta/validación).

Nota crítica: una métrica alta no equivale automáticamente a diagnóstico autónomo. Importan prevalencia, sesgo del dataset, variabilidad del laboratorio y condiciones reales de despliegue.

3.2 Nefropatología: nefritis lúpica (segmentación + clasificación)

Se ha aplicado IA para segmentar glomérulos y apoyar clasificación/actividad-cronicidad en biopsia renal digital. El impacto potencial: cuantificar lesiones con más consistencia, comparar evolución y estandarizar criterios entre centros.

3.3 Enfermedades por depósito: amiloidosis y “virtual staining”

En patología renal se exploran pruebas de concepto como la “tinción virtual” (aproximar tinciones especiales desde imágenes estándar). Es una línea prometedora en eficiencia/recursos, pero aún lejos de sustituir protocolos clínicos establecidos.

“Funciona en el paper” no significa “funciona en tu servicio”. El salto al mundo real exige validación local, integración en sistemas y monitorización continua.

4) Retos reales que determinan si “funciona” fuera del paper

4.1 Variabilidad preanalítica (el enemigo silencioso)

- Fijación, procesado, grosor de corte.

- Protocolos de tinción y lotes de reactivos.

- Artefactos (pliegues, burbujas, necrosis, crush), desenfoque.

Esto puede inducir batch effects: el modelo aprende “señales del laboratorio” (atajos) en vez de biología.

4.2 Infraestructura y costos

- Escáner WSI + almacenamiento (archivos grandes).

- Ancho de banda y visualización fluida.

- Ciberseguridad y gobierno del dato.

- Mantenimiento y actualización de modelos.

4.3 Interoperabilidad: DICOM/HL7 y sistemas clínicos

Para ser clínico de verdad debe integrarse con LIS/HIS/PACS. La adopción de DICOM para WSI y arquitecturas interoperables (p. ej., flujos HL7 para órdenes/resultados) es clave.

4.4 “Caja negra” y explicabilidad

En medicina, no basta con acertar: ¿por qué lo predice?, ¿en qué regiones se apoya?, ¿cuándo “no sabe” y debe abstenerse? Esto impulsa heatmaps, calibración de probabilidades, umbrales de seguridad y detección de out-of-distribution.

4.5 Evidencia clínica y regulación

Crecen productos comerciales, pero la evidencia pública es heterogénea. La clave: validaciones externas, datasets representativos, transparencia y auditoría de rendimiento en condiciones reales.

5) Repercusiones éticas (y cómo abordarlas de forma práctica)

La IA no “firma” diagnósticos. Un uso seguro exige: políticas de uso (tareas/casos/umbrales), auditoría por centro y subpoblaciones, y trazabilidad (versión del modelo, inputs, outputs, logs).

Si el entrenamiento proviene de pocos centros o poblaciones, puede fallar por subrepresentación, sesgo de escáner/tinción o rarezas histológicas. Solución realista: validación multicéntrica + monitorización continua.

Las WSI pueden contener metadatos y riesgo de reidentificación indirecta. Se requieren anonimización/pseudonimización, control de accesos y acuerdos de retención/procesamiento.

Declarar cuándo se usó IA (triage, cuantificación, etc.) y explicar limitaciones: apoya, no sustituye.

6) El dilema del patólogo: “¿me va a reemplazar?”

El cambio de rol es más probable que el reemplazo. La IA puede reducir tiempo en tareas repetitivas (screening, recuentos), y liberar agenda para correlación clínico-patológica, comités, biomarcadores complejos y seguridad diagnóstica.

- Menos tiempo en tareas repetitivas (screening, recuentos, cuantificación).

- Más tiempo en integración clínica y decisiones complejas.

- Cuantificación reproducible + trazabilidad.

- Mejora del control de calidad (inputs y outputs).

- Integración clínica completa (tratamientos, historia, iatrogenia, contexto).

- Diagnósticos raros/atípicos y razonamiento experto con baja prevalencia.

- Manejo de incertidumbre y discrepancias (segunda lectura, correlación con pruebas).

En la práctica, el patólogo se convierte también en: director de calidad diagnóstica, curador de datos (calidad de entrada) y supervisor de modelos (validación y drift).

7) Mapa conceptual interactivo: Flujo Patología Digital + IA

Toca/clic en un nodo para resaltarlo y ver sus conexiones. Puedes arrastrar dentro del mapa (mouse o touch) para moverte.

8) Glosario interactivo: términos que necesitas (WSI, MIL, drift, DICOM…)

Toca un término para expandir su definición.

9) Test interactivo (5 preguntas) + gráficos: ¿lo tienes claro?

10) Preguntas Frecuentes clínicas

En la práctica clínica, la IA no sustituye la firma médica. Funciona como soporte/dispositivo y el patólogo es responsable del informe.

Puede reducir algunos (omisiones, recuentos variables), pero también puede introducir otros (sesgos, fallos por artefactos). La clave es validación + monitorización.

WSI operativo, gobernanza del dato, integración (idealmente con estándares), validación local, formación y protocolo de uso.

Riesgo de drift y degradación. Debe haber recalibración y verificación periódica.

Sí: nefropatología (p. ej., nefritis lúpica), infecciosa, inflamatoria, cuantificación de fibrosis, etc., según evidencia y validación.

11) Disclaimer médico y de uso tecnológico

Este contenido es informativo y divulgativo. No sustituye la práctica clínica, la normativa local, ni la validación y aprobación regulatoria que corresponda a dispositivos/algoritmos. La implementación de IA en patología requiere validación local, control de calidad, gobernanza del dato, seguridad y supervisión profesional. En práctica clínica, el patólogo mantiene la responsabilidad final del informe.

12) Bibliografía (9 referencias, con DOI)

- Campanella G, Hanna MG, Geneslaw L, et al. Clinical-grade computational pathology using weakly supervised deep learning on whole slide images. Nat Med. 2019. doi:10.1038/s41591-019-0508-1.

- Coudray N, Ocampo PS, Sakellaropoulos T, et al. Classification and mutation prediction from non–small cell lung cancer histopathology images using deep learning. Nat Med. 2018. doi:10.1038/s41591-018-0177-5.

- Bera K, Schalper KA, Rimm DL, Velcheti V, Madabhushi A. Artificial intelligence in digital pathology — new tools for diagnosis and precision oncology. Nat Rev Clin Oncol. 2019. doi:10.1038/s41571-019-0252-y.

- Baxi V, Edwards R, Montalto M, Saha S. Digital pathology and artificial intelligence in translational medicine and clinical practice. Mod Pathol. 2022. doi:10.1038/s41379-021-00919-2.

- Matthews GA, McGenity C, Bansal D, et al. Public evidence on AI products for digital pathology. npj Digit Med. 2024. doi:10.1038/s41746-024-01294-3.

- Zheng C, et al. Deep Learning–Based Assessment of Lupus Nephritis on Whole Slide Images. Diagnostics. 2021. doi:10.3390/diagnostics11111983.

- Yang Q, et al. Virtual Congo red staining of renal amyloid on routine pathology images (virtual staining proof-of-concept). Nat Commun. 2024. doi:10.1038/s41467-024-52263-z.

- Lajara N, Espinosa-Aranda JL, Deniz O, Bueno G. Optimum web viewer application for DICOM whole slide image visualization in anatomical pathology. Comput Methods Programs Biomed. 2019. doi:10.1016/j.cmpb.2019.104983.

- Zarella MD, Bowman D, Aeffner F, et al. A Practical Guide to Whole Slide Imaging: A White Paper From the Digital Pathology Association. Arch Pathol Lab Med. 2019. doi:10.5858/arpa.2018-0343-RA.

¿Quieres una guía de implementación real (checklist) para tu servicio?

Si quieres un checklist práctico (WSI, validación local, drift, integración, auditoría, y protocolo de uso), escríbenos y te compartimos recursos actualizados.

Enviar email →Declaración de conflicto de intereses: el autor declara no tener conflictos financieros relevantes con las tecnologías o proveedores mencionados. Este artículo fue elaborado con fines informativos y divulgativos.